- Apple drtí konkurenci po svém

- Nejen, že si to myslí, ale sám tomu věří

- Čísla má skvělá, ale teď má problém, a ne malý

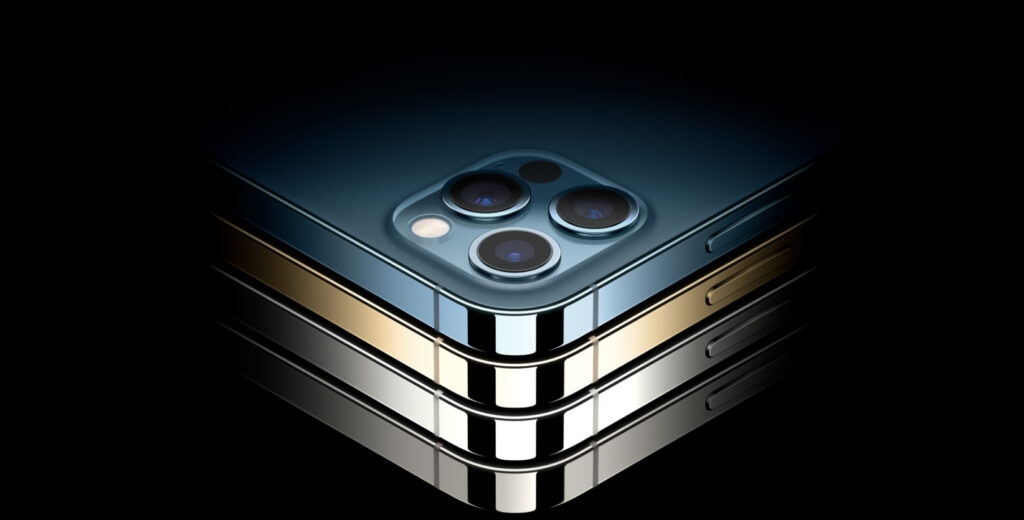

Apple si může mnout ruce. Loňské iPhony 12 se až na nejmenší iPhone 12 Mini prodávají skvěle a daří se mu i na poli služeb. Občas se ale stane, že svět najednou z ničeho nic svět zešedne a i přes fantastické prodejní výsledky máte najednou vrásky na čele. Zní to poeticky? Možná, ale mnohem lépe vyzní zprofanovaná fráze: když to nejmíň čekáte, vždy se něco “podělá”.

Nepřehlédněte: Apple ukončuje výrobu iPhone 12 mini, kvůli mizerným prodejům

Apple chce zatočit s dětskou pornografií

Možná jste v minulém týdnu zaregistrovali, že Apple se rozhodl vyrazit do boje se sexuálně nevhodným dětským obsahem a pornografií v rámci cloudové služby iCloud. Což o to, myšlenka je to ušlechtilá a v digitálním věku dokonce žádoucí. Nikdo z dnešních rodičů nechce už z podstaty věci přijít o to nejcennější: bezpečí a ochranu soukromí svých ratolestí.

Takže, v čem je problém a proč to zaměstnancům vadí? Jde o to, že z oficiálního postoje není tak nějak zřejmé, jakým způsobem chce data uživatelů lustrovat a vyhodnocovat. Kde je pomyslná hranice mezi rodinnou fotografií např. nahého dítěte v bazénu a skutečným dětským pornem? A hlavně, jak může dojít na zašifrovaném úložišti k jejich zcizení?

Zaměstnanci podniku to ale vidí jinak

Z dostupných informací je evidentní, že Apple chce použít srovnávací algoritmus (hash kód) nahraných snímků s databází fotek CSAM. To teoreticky znamená, že na výše zmíněná rodinná fota nebude brát zřetel, pakliže nedojde alespoň k 80% shodě s CSAM, kdy následuje “rudý praporek”, zpětná kontrola jablečným týmem a v případě podezření zalarmování sociálky.

Bohužel, je zde stále 20% prostor pro chybovost, omyl nebo selhání tohoto sofistikovaného systému, který může mít v některých případech až katastrofální důsledky, jak s odvoláním na panující obavy avizuje populární server MacRumors.

Takže osm stovek zaměstnanců to “jen” nepochopilo? Ne tak docela. Ve zprávách adresovaných výkonnému managementu poukazují na to, že se obávají, aby se z novinky nestal díky “salámové metodě” do budoucna nástroj, jak data; ať už na požádání třetích stran nebo vládních špiček, cenzurovat.

Čtěte také: Nejhodnotnější značkou světa je Amazon, následují Apple a Google

Co na to Apple? Mýlíte se, vzkazuje

Craig Federighi, víceprezident Applu, se nechal slyšet, že to nejen uživatelé, ale i zaměstnanci i odborná veřejnost vnímá naprosto zkresleně. Podle něj dojde ke skenování a porovnávání fotky v době uploadu před jejím uložením a běžný jedinec to ani nepozná.

To nezůstalo bez odezvy. Obratem se k tomu vyjádřila Eva Galperin, ředitelka sekce pro kyberbezpečnost ze společnosti EFF. Ta mu odpověděla, že to všichni chápou až moc dobře. Čemu však nikdo nerozumí je to, proč Apple ke kontrole fotografií požívá třetí stranu a nedisponuje vlastním in-house řešením (CSAM je v gesci NCMEC, Národní centrum pro pohřešované nebo týrané děti).

A také dodala (a nebyla jediná), že se z tohoto kroku může stát velmi nebezpečný precedens. I když pravda může být někde uprostřed, to nic nemění na faktu, že kalifornský podnik ze svého záměru neustoupí. Prý k tomu není důvod. Systém bude funkční, kontrola rychlá a efektivní, soukromí uživatelů nebude narušeno.

Kdy nová změna dorazí?

Dobrá otázka! Pokud se něco zásadního nezmění, Apple chce novinku nasadit s příchodem operačního systému iOS 15 a další generace iPadOS už letos na podzim.

Názor redakce

Jakýkoliv krok směrem k ochraně soukromí nejen dospělých, ale i dětí samozřejmě velmi kvitujeme. Problém vidíme pouze v tom, jak se k problematice Apple staví. Ještě před dvěma lety razil heslo: “What happens on your iPhone, stays on your iPhone”, což v překladu znamená: “Co se děje na Vašem iPhonu, zůstává na Vašem iPhonu”.

I když tímto postojem americký podnik dává jasně najevo, že s pedofily a dalšími pochybnými existencemi zatočí, je otázkou, na kolik to bude v praxi účinné. Myslíme si, že takových případů na iCloudu moc nebude. Je totiž vysoce pravděpodobné (a ví se to), že takoví neřádi se zdržují na darknetech a jiných pochybných webech. Jinými slovy, kýžený efekt se vůbec nemusí dostavit.